セルフ・ドライビング・カー開発と トロリー問題

2016.09.20

自動運転車が事故を起こした場合、誰の業務上過失になるのでしょうか?

自動運転車開発に関するモラルや法規制に関連して、トロリー問題あるいはトロッコ問題と言われるものが議論になっています。

トロリー問題というのは、倫理学の思考実験です。線路上を無人で走行する重たいトロッコが、暴走したとします。行く手には線路上で作業している人が5人もいます。あなたは分岐器のところにいて、線路を切り替えることができるとします。切り替えれば、5人は確実に助かりますが、切り替えた線路上には別の1人が作業中。この人はあなたの線路切り替えによって確実に命を落とします。分岐器のレバーを引きますか? 引きませんか? という問題です。

誰を傷つければいいのでしょう

5人の命と1人の命を比較して、奪う命が少ない方のレバーを引くという功利主義でよいのでしょうか。それとも、手を下さなければ死なずに済む1人の命を奪うべきではないのでしょうか。

自動運転車は、カメラやセンサーを搭載して、運転手がいなくても、あるいは、運転席に座っている人が運転を行わなくても、周囲の状況を「的確に」判断して走行します。

周囲の状況は刻々と変化し、自動車は高速で走行しますから、自動運転車の「頭脳」は、変化を察知したら即座に判断しなければなりません。時速40kmなら1秒で11m以上進みます。

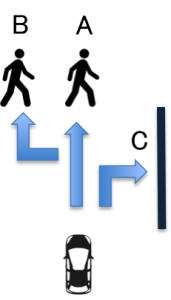

自動運転車の進む方向に歩行者が1人以上いて、このまま進めば轢き殺してしまうとしましょう。人や障害物を轢いても、怪我するだけで死にはしないかも知れませんが、ぶつかれば死んでしまうと考えることにします。話を単純にするために、自動車には3つの選択肢しかないと仮定します。

- そのまま進んで歩行者Aを轢き殺す

- ハンドルを切って別の方向の歩行者Bを轢き殺す

- ハンドルを切って壁に衝突し、運転車と同乗者Cを事故死させる

急ブレーキは間に合わず、このまま進めば、前方のAさんを轢いてしまいます。

左にハンドルを切れば、別の歩行者のBさんを轢いてしまいます。

右にハンドルを切ると壁に激突して同乗者が怪我をします。

今後、カメラも画像認識もどんどん進歩しますから、自動運転車のAIは、瞬時にいろいろなことを判断できるようになります。

Aが5人、Bが1人だったら、5人を助けて1人を轢くべきでしょうか。

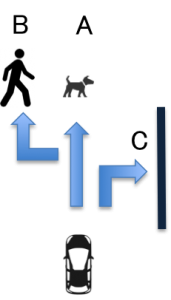

Aは犬、Bが人なら、このまま犬を轢き殺すべきでしょうか。

Aは杖をついた高齢者で、Bがジョギング中の元気そうな若者であれば、Bが避けてくれることに賭けてBの方へ向かうべきでしょうか。

Cでは同乗者が怪我するけど死ぬ可能性が低いなら、自ら壁に激突すべきでしょうか。同乗者がシートベルトをしていないことにAIが気づいたら、やはりAかBの人を轢いてでも同乗者を守るべきでしょうか。

Aも動物、Bも動物だったらCは避けるというのでよいのでしょうか。

自動運転車の「認可」でこうした際にどのように「判断」するAIが認められるのか、もし、こうした点はメーカーの裁量に任されてしまった場合、消費者が自動運転車を購入する際、どのように判断する車種を選べば、倫理的に正しいのか、自分の身を守ることになるのか。

実際に事故が起こることは避けられないはずですから、規制、メーカーの責任、開発者の倫理、販売のルール、消費者の判断など、多くの問題をはらむ課題です。

映画「スピード」の、暴走するバスが交差点でベビーカーを跳ね飛ばしてしまう場面が思い出されてなりません。